- Искусственный Интеллект: Между Свободой Кода и Законом – Правовое Поле ИИ

- Что такое Искусственный Интеллект в Юридическом Контексте?

- Проблемы Ответственности и ИИ

- Защита Данных и Приватность в Эпоху ИИ

- Регулирование ИИ в Мире: Обзор Подходов

- Этические Аспекты ИИ: Моральный Компас для Разработчиков

- Будущее Правового Регулирования ИИ: Куда Мы Движемся?

- Как ИИ влияет на авторское право?

- Проблемы с конфиденциальностью при использовании ИИ․

- Применение ИИ в уголовном праве․

Искусственный Интеллект: Между Свободой Кода и Законом – Правовое Поле ИИ

Мир стремительно меняется․ Искусственный интеллект (ИИ) перестал быть фантастикой из кино – он прочно вошел в нашу повседневную жизнь․ От рекомендаций фильмов до систем управления автомобилем‚ ИИ влияет на наши решения и действия․ Но вместе с этим возникает и множество вопросов: кто несет ответственность‚ если ИИ совершает ошибку? Как защитить свои права в мире‚ где алгоритмы принимают решения за нас? Как регулировать эту мощную технологию‚ не задушив при этом инновации?

Мы‚ как активные пользователи и наблюдатели за развитием технологий‚ решили погрузиться в тему правового регулирования ИИ․ Нам интересно‚ как законодатели по всему миру пытаются найти баланс между поддержкой прогресса и защитой прав граждан․ Мы хотим поделиться своими размышлениями и наблюдениями‚ чтобы вместе разобраться в этом сложном‚ но крайне важном вопросе․

Что такое Искусственный Интеллект в Юридическом Контексте?

Прежде чем говорить о правовом регулировании‚ важно понять‚ что мы подразумеваем под термином "искусственный интеллект"․ Это не просто компьютерная программа․ Это сложная система‚ способная к обучению‚ адаптации и принятию решений на основе полученных данных․ ИИ может быть представлен в разных формах: от чат-ботов до автономных дронов․ Именно эта способность к самостоятельным действиям и ставит перед юристами сложные вопросы․

Юридическое определение ИИ до сих пор находится в стадии формирования․ Нет единого‚ общепринятого определения‚ которое бы использовалось во всех странах․ Это создает определенные трудности‚ поскольку разные юрисдикции могут по-разному трактовать одни и те же ситуации‚ связанные с ИИ․ Важно понимать‚ что именно способность к обучению и принятию решений‚ отличает ИИ от обычного программного обеспечения․

Проблемы Ответственности и ИИ

Один из самых сложных вопросов в правовом регулировании ИИ – это вопрос об ответственности․ Кто виноват‚ если автономный автомобиль совершит ДТП? Разработчик программного обеспечения? Производитель автомобиля? Владелец? Или сам ИИ?

Традиционные юридические концепции‚ такие как вина и причинно-следственная связь‚ не всегда применимы к ситуациям‚ связанным с ИИ․ Алгоритмы могут принимать решения на основе сложных статистических моделей‚ которые трудно понять и объяснить․ Это затрудняет установление вины и привлечение к ответственности․

- Ответственность разработчика: Если ошибка в алгоритме привела к негативным последствиям‚ можно ли привлечь к ответственности разработчика? Какие требования должны предъявляться к процессу разработки ИИ?

- Ответственность производителя: Если ИИ встроен в устройство‚ например‚ автомобиль‚ несет ли производитель ответственность за действия ИИ?

- Ответственность пользователя: Если пользователь не соблюдает правила использования ИИ‚ несет ли он ответственность за последствия?

- Ответственность самого ИИ: Возможно ли в будущем признание ИИ субъектом права и возложение на него ответственности?

Защита Данных и Приватность в Эпоху ИИ

ИИ нуждается в огромном количестве данных для обучения и работы․ Эти данные часто содержат личную информацию о пользователях․ Как обеспечить защиту этих данных и сохранить приватность в эпоху ИИ?

Вопросы защиты данных и приватности становятся особенно актуальными в связи с развитием систем распознавания лиц‚ анализа больших данных и профилирования пользователей․ Необходимо разработать четкие правила‚ регулирующие сбор‚ хранение и использование персональных данных ИИ․

Вот некоторые аспекты‚ которые требуют особого внимания:

- Согласие на обработку данных: Как получить осознанное согласие пользователя на обработку его данных ИИ?

- Прозрачность алгоритмов: Как обеспечить прозрачность алгоритмов ИИ‚ чтобы пользователи могли понимать‚ как их данные используются?

- Право на забвение: Как реализовать право пользователя на удаление своих данных из системы ИИ?

- Защита от дискриминации: Как предотвратить использование ИИ для дискриминации по расовому‚ половому или иным признакам?

Регулирование ИИ в Мире: Обзор Подходов

В разных странах мира применяются различные подходы к регулированию ИИ․ Некоторые страны предпочитают разрабатывать специализированные законы‚ регулирующие конкретные аспекты использования ИИ․ Другие страны делают ставку на саморегулирование и этические кодексы․

Рассмотрим несколько примеров:

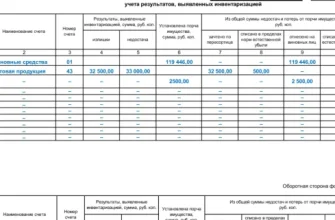

| Страна | Подход к регулированию ИИ | Ключевые особенности |

|---|---|---|

| Европейский Союз | Комплексное законодательство (AI Act) | Классификация ИИ по уровню риска‚ строгие требования к высокорисковым системам‚ защита прав граждан․ |

| США | Секторальное регулирование‚ акцент на саморегулирование | Разработка стандартов и рекомендаций отраслевыми организациями‚ регулирование отдельных сфер‚ таких как здравоохранение и финансы․ |

| Китай | Государственное регулирование‚ поддержка инноваций | Активное участие государства в развитии ИИ‚ поддержка исследований и разработок‚ строгий контроль за использованием данных․ |

| Канада | Закон о искусственном интеллекте и данных (AIDA) | Направлен на регулирование торговой деятельности‚ связанной с системами искусственного интеллекта․ |

| Россия | Стратегия развития искусственного интеллекта | Определение приоритетных направлений развития ИИ‚ поддержка научных исследований‚ создание благоприятных условий для бизнеса․ |

Важно отметить‚ что процесс регулирования ИИ находится в самом начале․ Нет единого мнения о том‚ какой подход является наиболее эффективным․ Каждая страна выбирает свой путь‚ исходя из своих национальных особенностей и приоритетов․

"Технологии нейтральны․ Нейтральны до тех пор‚ пока их не используют․"

ー Уильям Гибсон

Этические Аспекты ИИ: Моральный Компас для Разработчиков

Правовое регулирование – это лишь один аспект проблемы․ Не менее важны этические вопросы‚ связанные с разработкой и использованием ИИ․ Как обеспечить‚ чтобы ИИ соответствовал нашим моральным ценностям? Как избежать предвзятости и дискриминации в алгоритмах?

Разработчики ИИ должны учитывать этические аспекты на всех этапах разработки – от сбора данных до внедрения системы․ Необходимо разрабатывать этические кодексы и стандарты‚ которые бы определяли принципы разработки и использования ИИ․

Ключевые этические принципы:

- Справедливость: ИИ не должен дискриминировать по расовому‚ половому или иным признакам․

- Прозрачность: Алгоритмы ИИ должны быть понятными и объяснимыми․

- Ответственность: Должны быть четко определены лица‚ ответственные за действия ИИ․

- Конфиденциальность: Персональные данные должны быть защищены․

- Благонадежность: ИИ должен использоваться во благо общества․

Будущее Правового Регулирования ИИ: Куда Мы Движемся?

Правовое регулирование ИИ – это динамичный процесс‚ который будет развиваться вместе с развитием технологий․ В будущем нас ждет появление новых законов и нормативных актов‚ регулирующих различные аспекты использования ИИ․ Возможно‚ будут созданы специализированные суды‚ рассматривающие споры‚ связанные с ИИ․ Важно‚ чтобы правовое регулирование не сдерживало инновации‚ а создавало благоприятные условия для развития ИИ во благо общества․

Мы верим‚ что открытая дискуссия и сотрудничество между юристами‚ разработчиками‚ политиками и обществом помогут найти оптимальный баланс между свободой инноваций и защитой прав граждан в эпоху ИИ․

Как ИИ влияет на авторское право?

Проблемы с конфиденциальностью при использовании ИИ․

Применение ИИ в уголовном праве․

Подробнее

| Правовое регулирование ИИ | Ответственность за действия ИИ | Защита данных в ИИ | Этика искусственного интеллекта | ИИ и авторское право |

| Конфиденциальность и ИИ | ИИ в уголовном праве | Регулирование ИИ в России | AI Act Европейского Союза | Риски использования ИИ |